Dr.med. ChatGPT – Wie uns die KI den Arbeitsplatz streitig macht

Letztes Jahr erzählte mir der französische Mathematiker und Fields Medal Gewinner Cedric Villani etwas polemisch, dass es seiner Ansicht nach genau drei sinnvolle Anwendungen für die KI gebe:

Erstens, schlechte erotische Romanzen zu schreiben. Zweitens, fantasielose Drehbücher zu generieren. Drittens, in der medizinischen Diagnostik.

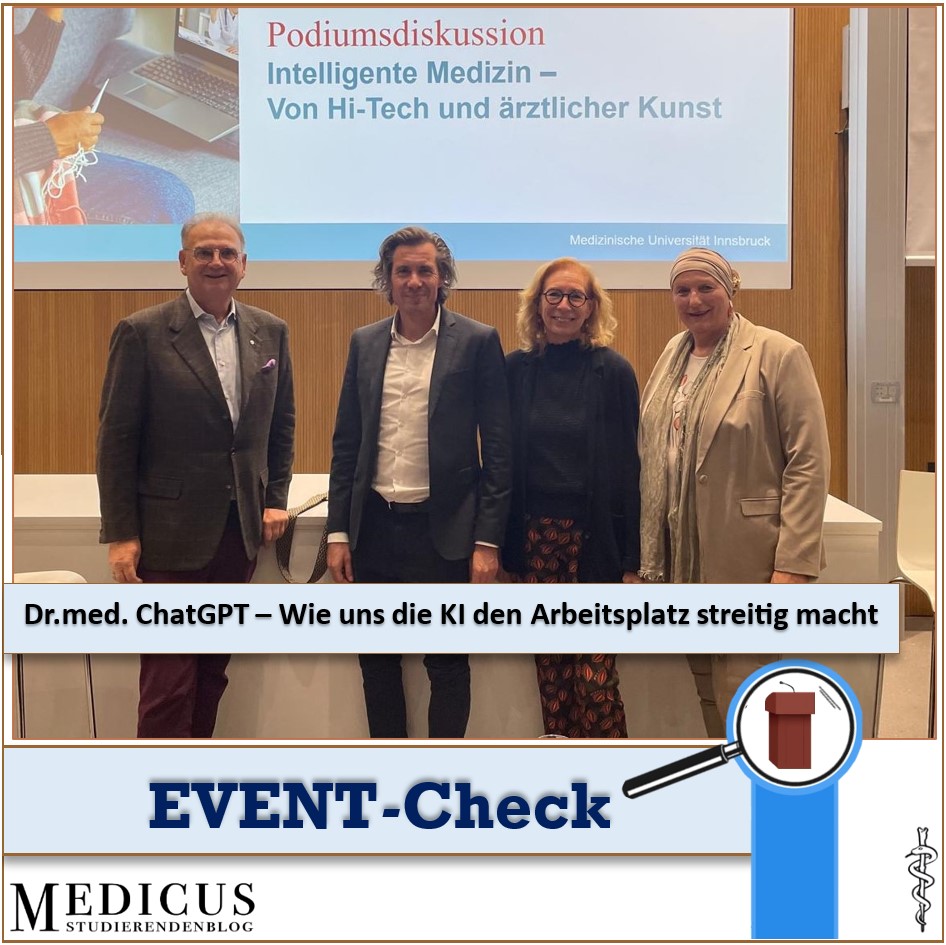

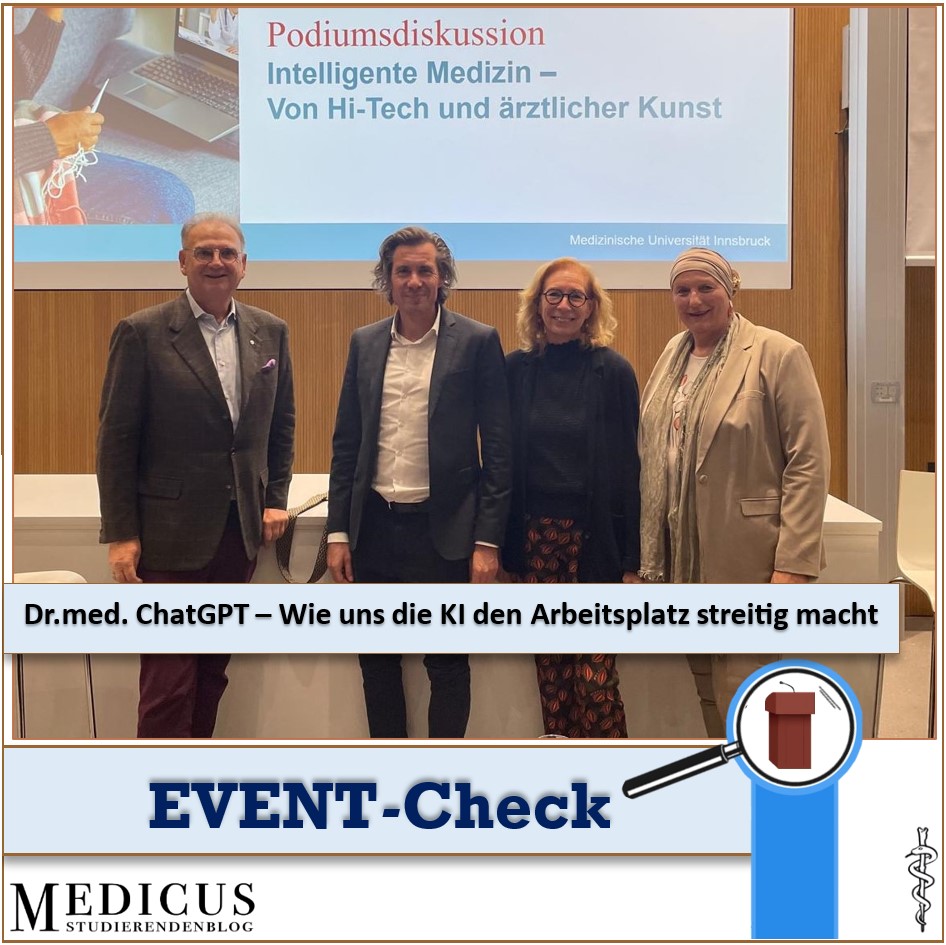

Dafür, dass von vielen ernstzunehmenden Experten des medizinischen Forschungsraumes die Medizindiagnostik einer der wenigen Bereiche ist, wo die KI einen großen Fortschritt bringen könnte und bereits tut, war der Veranstaltungsraum nicht ganz ausgefüllt. Erfahrungsgemäß korreliert die Qualität einer Diskussion nicht mit der Quantität an Zuhörern – wie überlaufene Veranstaltungen von Krypto-Coaches und Self-Help Gurus immer wieder beweisen. Letztendlich fand sich eine kleine, aber interessierte Hörerschaft in den ersten Reihen des Audimax wieder. Der Medicus war auch dabei.

Anfangsstatements

Das Anfangsstatement kam von der Direktorin der Univ.-Klinik für Psychiatrie II, Prof. Barbara Sperner-Unterweger. Das befasste sich mit der ärztlichen Kunst: Die Arbeit eines Arztes, so Sperner-Unterweger, bestehe aus zwei Teilen. Zum einen der „mechanische“, also der Teil der genauen Anamnese, der raschen Diagnostik und der evidenzbasierten Behandlung. Zum anderen gibt es auch den „künstlerischen“ Aspekt: Das betrifft die subjektive Krankheitswahrnehmung der Symptomatik, Sorgen und Ängste des Patienten.

Vor allem im “mechanischen” Teil könne die KI neue Möglichkeiten eröffnen. In letzterem eher nicht, da das ärztliche Gespräch nicht ohne Qualitätseinbußen durch eine Maschine ersetzt werden könne. Man müsse daher die Integration der KI weniger als Mitstreiter um die ärztlichen Kompetenzen, sondern mehr als Ergänzung verstehen, die nicht Behandlungsverantwortung übernimmt, sondern dabei helfen soll, die Kommunikationskomponente zu erhöhen.

An die Thematik der ärztlichen Kunst anschließend, fragte die Intensivmedizinerin und Medizinethikerin Prof. Barbara Friesenecker auf provokante Weise, wo die Heilkunst bei all dem technischen Fortschritt geblieben sei und ob der Heilkünstler schon längst zum Medizinmechaniker verkommen wäre. Auch Prof. Friesenecker schloss sich dem ersten Statement an und argumentierte, dass die KI als ein Werkzeug zu begreifen sei, dass nur so intuitiv sein könne, wie die darunterliegende Programmierung. Zusätzlich betonte sie, dass die KI dem Personalmangel im medizinischen Bereich entgegenwirken könne, indem Zeit von „lästiger“ Arbeit genommen und in Gespräche investiert werden könne.

Als letzter der Runde ergriff Kardiologe Prof. Axel Bauer das Wort. Er konstatierte, dass die KI das Potenzial hätte, die Medizin grundlegend zu transformieren. Vor allem in „mechanischen“ Bereichen der Diagnostik und personalisierter Behandlung. Auch er betonte, dass die KI als ein Co-Pilot verstanden werden müsse und die eigentliche Herausforderung rechtlicher und ökonomischer Natur seien: Wem gehören die Rechte der Daten mit der die KI trainiert wird? Wird die KI eingesetzt, um Menschen zu helfen, oder um Profite zu maximieren?

Qualität der Daten

Daraufhin kreisten die Diskussion und die anschließenden Fragen aus dem Publikum um mehrere Aspekte:

Zum einen über die Datenerhebung, -verarbeitung und -sicherheit. Wie können wir sicher sein, so die Befürchtung, dass die Daten, mit der die KI trainiert wird, auch einen hohen Qualitätsstandard haben und es nicht zu einem „Garbage in, Garbage out“-Prozess komme?

(Das bedeutet, dass schlechte Daten, zu schlechten Informationen führen, die wiederum zu schlechten Ergebnissen bzw. Entscheidungen führen.)

Prof. Bauer wies darauf hin, dass es mittlerweile Entwicklungen in der KI-Forschung gebe, die nahelegen, dass KI bald selbst in der Lage sein werde, schlechte Daten selbst zu erkennen. Dabei erzählte er, dass angesehene Medizinjournale die Qualitätsstandards eingesendeter Arbeiten mithilfe einer KI überprüfen würden und 8-10 % der Arbeiten dadurch abgewiesen werden würden. Aber er war sich auch durchaus bewusst, dass schlechte Daten in den meisten Fällen auch schlechte Ergebnisse liefern.

Zur Klarheit muss erwähnt werden, dass Prof. Bauer in seinen Diskussionsbeiträgen fast ausschließlich von “harten Daten” sprach: Also Daten, die eine geringe Fehleranfälligkeit hätten, wie zum Beispiel aus CTs, MRTs und Laborbefunden.

Hingegen wurde mir der Eindruck vermittelt, dass Prof. Friesenecker und Prof. Sperner die Co-Pilot Funktion der KI in Bezug auf subjektive und ethische Aspekte bezogen. Prof. Friesenecker brachte das Beispiel ein, dass bei der palliativen “End of Life Decision” bereits erste Versuche mit von ChatGPT generierten Handlungsvorschlägen durchgeführt wurden. Prof. Sperner-Unterweger schloss sich dem an. Sie zitierte eine Studie, die davon handelte, wie groß das Vertrauen bei Patienten in die KI in einem medizinischen Setting war. Spoiler: Nicht wirklich groß. Besonders niedrig war das Vertrauen, wenn kein Arzt im Raum war.

Verlernen von Kompetenzen

Leider blieb meine Frage, wie sichergestellt werden könne, dass durch Auslagerung von Kompetenzen an die KI verhindert werde, dass Ärzte diese verlernen und dann z.B. bei einem technischen Ausfall trotzdem richtig handeln, unbeantwortet.

Zweifel an der KI-Rolle in einem überlasteten System

Die Sicherheit, mit denen die Diskutanten von der zukünftigen Entwicklung der KI-Nutzung sprachen, verunsicherte einige Zuhörer. Diese fragten, wie sie denn so sicher sein könnten, dass die KI wirklich nur als Co-Pilot, Assistent oder Ampelsystem fungieren würde. Wäre es nicht viel wahrscheinlicher, dass – in einem von Kostendruck und Personalmangel geplagten System – Entscheidungsprozesse auf die KI ausgelagert werden würden. Achtung: Das bedeutet allerdings nicht, dass dadurch mehr Zeit für den Patienten übrigbliebe. Dies sei ohnehin ein Mythos, betonte eine weitere Zuhörerin aus dem Publikum. Eine zufriedenstellende Antwort gab es zu diesen Bedenken nicht.

Endstatements

Es folgten noch weitere Anmerkungen, provokante Fragen und neue Dimensionen eröffnende Meldungen aus dem Publikum und von Moderator Rektor Fleischhacker.

Letztendlich waren sich alle drei Gäste einig, es müsse viel mehr Aufklärung betrieben werden, um der Bevölkerung unbegründete Ängste zu nehmen. Insgesamt solle die KI als Werkzeug verstanden werden, die uns in unseren Entscheidungen “besser macht”.

Bei einem wunderbar organisierten Buffet konnte noch über das Gehörte mit den Vortragenden geplaudert werden. Ein erfolgreicher Abend über eine Thematik, die noch viel Diskussion bedarf, und auch hier im Medicus bald schon weiter behandelt wird.

Wird uns die KI als fähige Ärzte bald ersetzen?

Hier dargestellt als Symbolbild Dr.med. Toilet aus Scrubs (6.20).

© (1)

_____________________

Genderhinweis: Allein aus Gründen der Lesbarkeit wird auf die gleichzeitige Verwendung der Sprachformen männlich, weiblich und divers (m/w/d) verzichtet. Sämtliche Personenbezeichnungen gelten gleichermaßen für alle Geschlechter.

_____________________

Quellen (Bilder):

- Hauptbild: Medicus-Fotoredaktion

- (1): Dr. Toilet (Scrubs): My Conventional Wisdom (6.20)

Gianluca Purzer

Redakteur